DMZ – BLICKWINKEL ¦ Peter Metzinger ¦

In der aktuellen Nachrichtenflut ist es aufgrund der Häufigkeit von Fehlinformationen für die Verbraucher immer wichtiger geworden, beim Konsum von Inhalten Vorsicht walten zu lassen. Das Aufkommen generativer KI in Verbindung mit der raschen Verbreitung von Inhalten auf den verschiedenen Social-Media-Plattformen hat ein kompliziertes Netz geschaffen, in dem es immer schwieriger wird, Fakten von Fiktion zu unterscheiden. Schauen wir uns die jüngsten Taktiken an, die zur Beeinflussung der öffentlichen Meinung und zur Manipulation von Narrativen eingesetzt werden.

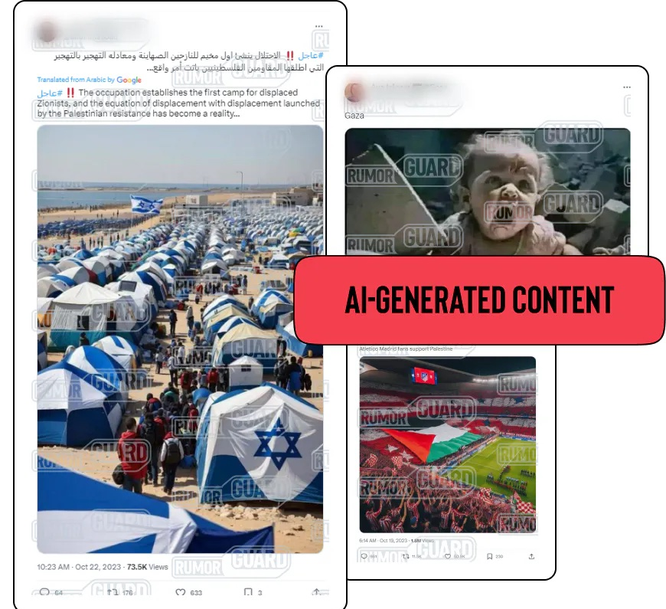

In der jüngsten Flut von Eilmeldungen stützen sich die auf sozialen Medienplattformen – von Facebook bis hin zu professionellen Plattformen wie LinkedIn – verbreiteten Erzählungen auf visuell unterstützte Inhalte, unabhängig davon, ob sie auf glaubwürdigen oder irreführenden Informationen beruhen.

Generative KI ist die Technologie, der Deepfakes, gefälschte Sprachaufnahmen und Manipulation von Inhalten zugrundeliegen. Sie hat erheblichen Einfluss auf die Verbreitung von Fehlinformationen. Dieser Anstieg hat zu dem geführt, was manche als «algorithmisch gesteuerten Nebel des Krieges» bezeichnen, so dass große Nachrichtenorganisationen und soziale Medienplattformen mit der Lawine von Desinformationen zu kämpfen haben.

Warum wenden sich Desinformationsagenten KI-generierten Inhalten zu?

Generative KI ist zu einem zentralen Instrument der öffentlichen Meinungsbildung geworden. Aktivisten nutzen KI-generierte Bilder und Videos, um entweder Unterstützung zu gewinnen oder den falschen Eindruck zu erwecken, dass ein bestimmtes Anliegen in einem Konflikt breite Unterstützung findet.

Beispiele dafür gibt es zuhauf: KI-generierte Plakate in Tel Aviv, die für die israelischen Verteidigungsstreitkräfte werben. Oder gefälschte Bilder, die Kinder unter Trümmern zeigen. Die Liste der betrügerischen Verwendungen ist lang.

@c4news A fake video of Bella Hadid recanting her support for Palestinians in the ongoing conflict between Israel and Hamas has gone viral. #News #BellaHadid #Israel #Palestine #Gaza #Hamas #AI ♬ original sound - Channel 4 News

Herausforderungen bei der Erkennung von KI-generierten Inhalten

Die Erkennung von KI-generierten Inhalten bringt eine Reihe von Herausforderungen mit sich. In einigen Fällen weist das verdächtige Filmmaterial keine offensichtlichen Anzeichen einer KI-Manipulation auf. Es ist schwierig, zwischen echten und manipulierten Inhalten zu unterscheiden. Sich bei der Erkennung digitaler Manipulationen ausschließlich auf KI-Erkennungstools zu verlassen, ist zudem ein heikles Unterfangen. Diese Tools erweisen sich oft als unzuverlässig und diagnostizieren gelegentlich Bilder und Videos falsch.

Die Suche nach Lösungen

Angesichts dieser Herausforderungen erforschen Initiativen wie die «Coalition for Content Provenance and Authenticity» in Zusammenarbeit mit Unternehmen wie Google Strategien, um die Herkunft und Geschichte von Mediendateien offenzulegen. Auch wenn diese Lösungen nicht ohne Mängel sind, verspricht man sich davon, das Vertrauen in die Qualität der Inhalte wiederherzustellen.

Andere Manipulationstechniken, die vor allem während des aktuellen Konflikts zum Einsatz kommen und über die bereits in ReclaimTheFacts berichtet wurde, sind für Ihr Verständnis und Ihren Schutz vor Fehlinformationen unerlässlich. Zu diesen Techniken gehören die Narrative, der Einsatz von Religion zur psychologischen Manipulation und der Einsatz von Angstmacherei und Sensationstaktiken. Es ist wichtig, sich dieser Techniken bewusst zu sein. Wir greifen sie in unserer laufenden Berichterstattung immer wieder auf.

Dieser Text erschien ursprünglich auf http://ReclaimTheFacts.com

Kommentar schreiben